Bespreking

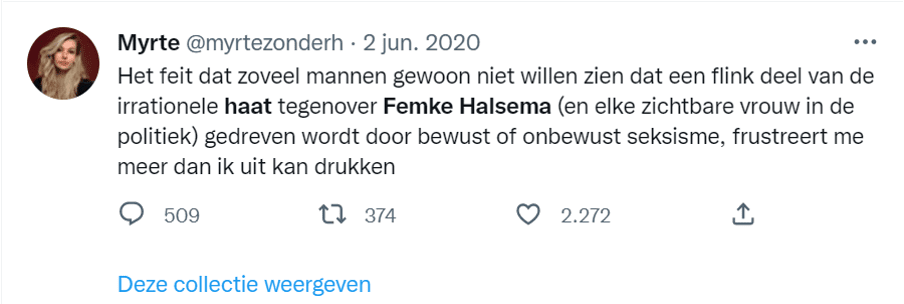

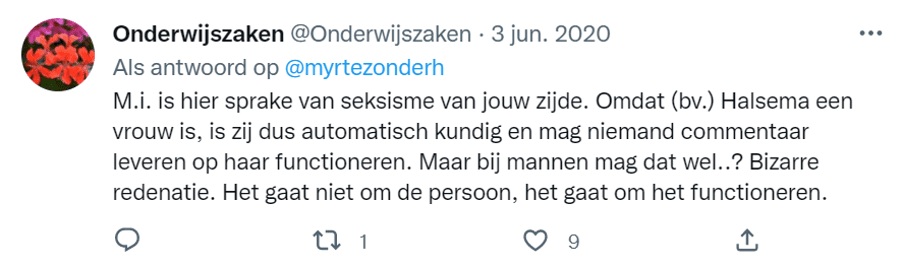

De voorgestelde tweets zijn vaak negatief, maar dat wil niet zeggen dat ze ook haatdragend of agressief zijn. Let erop dat het erom gaat op wie of wat de negativiteit gericht is. Gaat het om de inhoud of om de persoon? En als het om een persoon gaat, gaat het dan om de politica in kwestie of iemand anders?

Tijdens het bespreken van de labels (haatdragend of niet-haatdragend, agressief of niet-agressief) zullen de studenten vermoedelijk ontdekken dat er een grijs gebied is. Dat grijze gebied wordt nog groter op het moment dat studenten proberen te bepalen of de haat of agressie gericht is op gender, etniciteit, of iets anders. Dit plaatst de uitkomsten van het onderzoek van De Groene Amsterdammer in perspectief.

Reflecteer met elkaar: zou iedereen de tweets hetzelfde classificeren? Waar verschillen de meningen? En hoe moet je daar als redactie mee omgaan?

Je kunt de oefening afronden door terug te keren naar het onderzoek van de Groene Amsterdammer. Hoe kijken jullie na deze oefening tegen de uitkomsten aan? Vinden jullie de aanpak van het medium wenselijk? Wat zouden jullie hetzelfde of juist anders doen?

Materiaal

- De casus over De Groene Amsterdammer (geprint of op laptop)

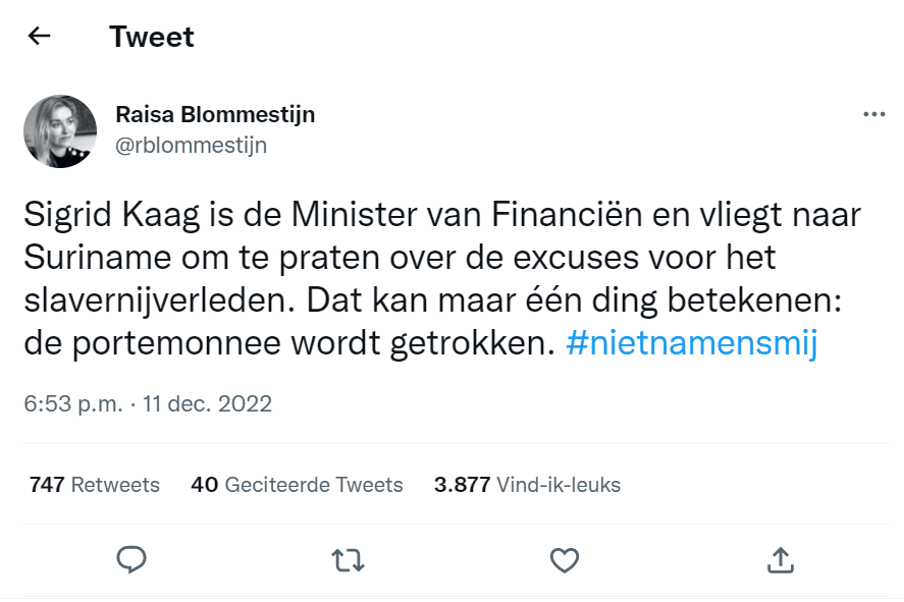

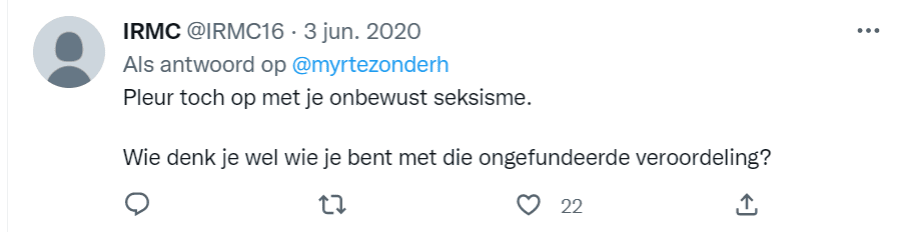

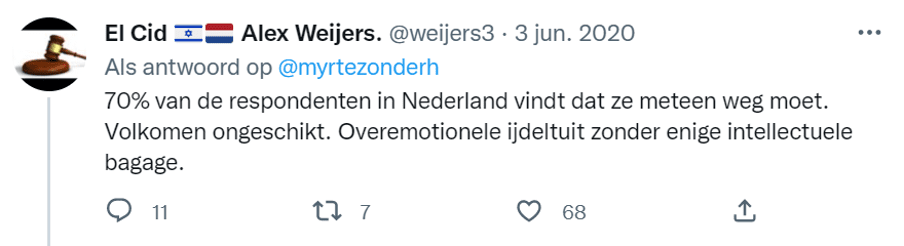

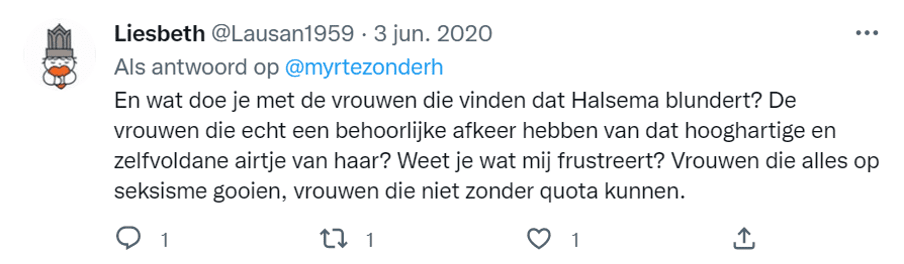

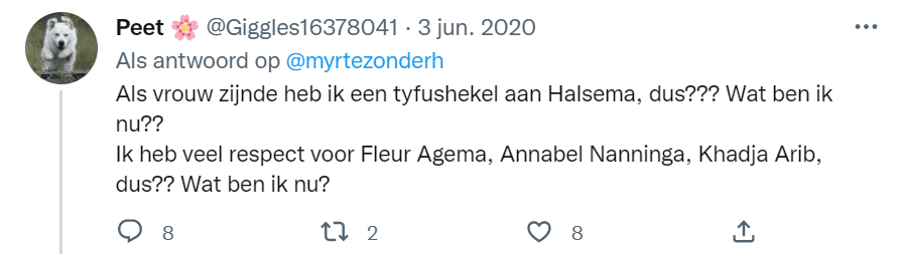

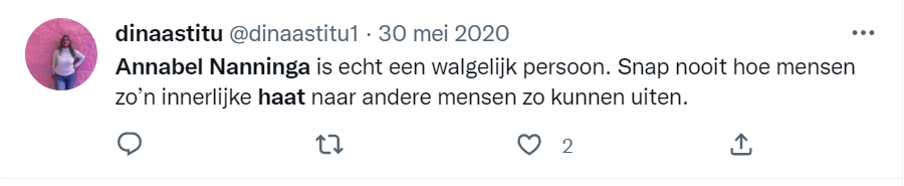

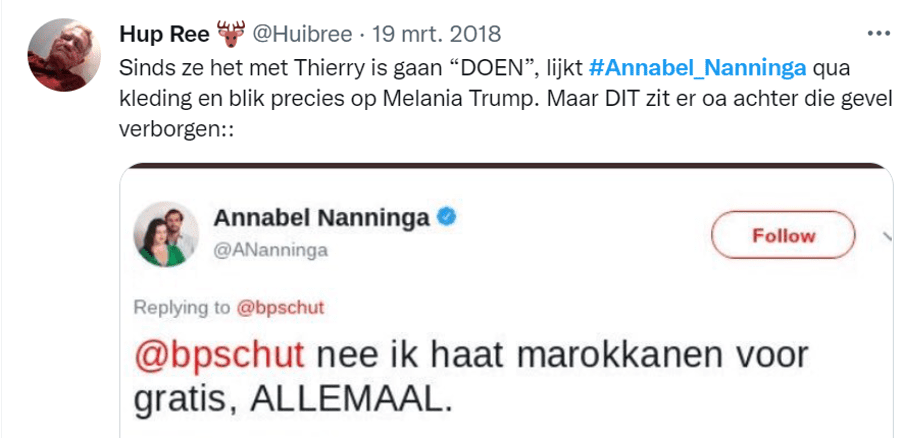

- De voorbeeld Tweets

Tijdsindicatie

Inclusief het lezen van het verhaal en de nabespreking: 60 minuten.

- De docent kan de opdracht inkorten door de klas in groepjes te verdelen en de tweets te verdelen over de groepjes.

- De docent kan de opdracht uitbreiden door de studenten zelf te laten zoeken naar tweets waarvan ze niet zeker zijn in welke categorie ze behoren.

- Als docent kun je de studenten bovendien aanmoedigen om de beknopte uitleg over Inter Annotator Agreement te lezen, en te proberen dit met elkaar te bereiken.